Meta heeft besloten het gaspedaal in te trappen met haar eigen familie van accelerators, MTIA, en daarmee een duidelijkere trend te versterken binnen de grote hyperscalers: minder afhankelijk worden van één enkele GPU-architectuur voor AI-inferentie. In een technische update gepubliceerd door het bedrijf, worden vier nieuwe generaties van de Meta Training and Inference Accelerator lijn weergegeven — MTIA 300, 400, 450 en 500 — met al lopende of geplande implementaties tussen 2026 en 2027. Centraal in de boodschap staat: AI-inferentie vereist chips die op een andere manier geoptimaliseerd zijn dan die voor training bedoeld.

De visie van Meta sluit aan bij een bredere sectorbeweging. Google presenteerde al Ironwood als haar eerste TPU specifiek ontworpen voor de “inferentietijd”, AWS duwt haar familie Trainium en Inferentia verder, en Microsoft introduceert Maia 200 als haar nieuwe eigen accelerator voor inferentiewerkzaamheden. Het is nog geen volledige vervanging van Nvidia, maar wel een groeiende diversificatie in de siliciumlaag, waarin kosten per token en energie-efficiëntie belangrijker worden naast brute kracht.

Meta legt uit dat haar MTIA-familie, ontwikkeld “naast (samenwerking met) Broadcom”, een belangrijke pijler blijft van haar AI-infrastructuurstrategie, naast andere interne en externe oplossingen. Het bedrijf meldt al

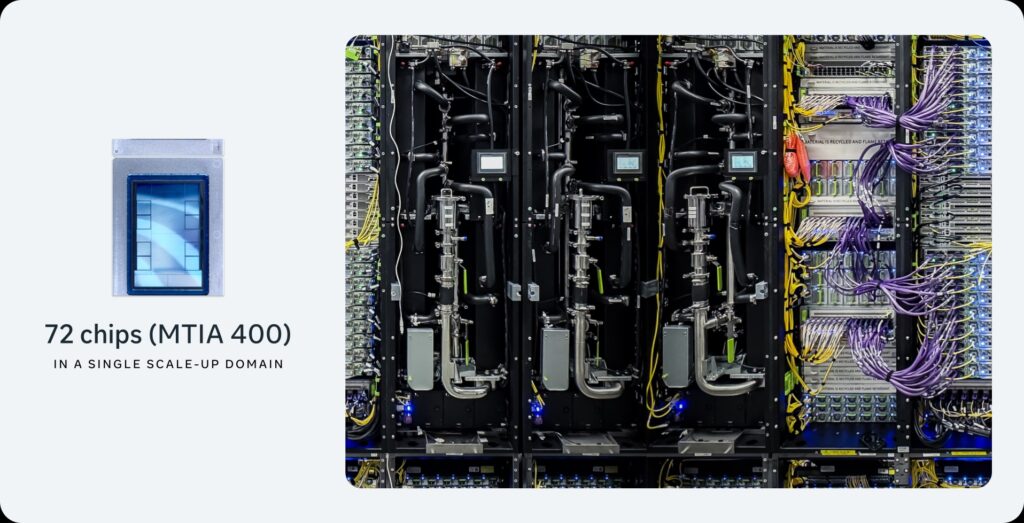

Wat vooral opvalt aan de aankondiging, is niet enkel het aantal generaties, maar vooral de focus. Meta beweert dat vanaf MTIA 300 tot MTIA 500 het bandbreedte van HBM met 4,5 keer toeneemt en de rekencapaciteit met 25 keer wordt verhoogd, en dat allemaal binnen minder dan twee jaar. Volgens hun roadmap is MTIA 300 al in productie voor training van ranking- en aanbevelingsmodellen; MTIA 400 is gereed voor laboratoriumtesten en maakt zich klaar voor datacenters; MTIA 450 wordt begin 2027 groots uitgerold; en MTIA 500 volgt later dat jaar.

Inferentie als nieuw strijdveld

Het technische argument van Meta draait om een heel concreet idee: bij generatieve inferentie ligt de bottleneck niet altijd op dezelfde plek als bij training. Het bedrijf benadrukt dat het bandbreedte van HBM-geheugen een van de belangrijkste factoren is voor inferentieprestaties, vooral in de decodeerfase. Daarom stelt Meta dat MTIA 450 de HBM-bandbreedte verdubbelt ten opzichte van MTIA 400, en dat MTIA 500 deze nog eens met 50% verhoogt, naast verbeteringen in capaciteit en prestaties met lage-precisie formaten gericht op inferentie.

Op strategisch vlak betekent dit dat de rol van GPU’s langzaam verandert. Jarenlang waren GPU’s de onbetwiste standaard voor zowel training als inferentie. Maar de grote hyperscalers beginnen te erkennen dat het altijd gebruiken van hetzelfde hardwaretype niet het meest efficiënt is, zeker nu inferentie het grootste deel van het totale compute-verbruik uitmaakt. Daar komen Meta, Google, AWS en Microsoft samen: eigen chips voor voorspelbare, grootschalige workloads, terwijl GPU’s nog steeds domineren voor frontier-training en meer universele toepassingen.

Google maakte dit al expliciet met Ironwood, dat haar zevende generatie TPU voorstelt, speciaal ontworpen voor inferentie, met 192 GB HBM3E, 7,37 TB/s bandbreedte en schaalbaarheid tot 9.216 accelerators. AWS presenteert Trainium3 met 144 GB HBM3E en 4,9 TB/s per chip, plus systemen UltraServer die tot 144 chips kunnen verbinden. Microsoft positioneerde in januari 2026 Maia 200, een inferentie-accelerator op 3 nm gebaseerd, uitgerust met 216 GB HBM3E, 7 TB/s bandbreedte en een prestatieverbetering van 30% per dollar ten opzichte van eerdere systemen van hun eigen vloot.

Minder afhankelijkheid van Nvidia, maar geen breuk

Dit betekent niet dat Nvidia morgen haar centrale positie verliest. Meta staat daar ook niet om te springen. Het bedrijf benadrukt dat het een divers portfolio aan interne en externe siliciumoplossingen blijft gebruiken, en dat de markt nog steeds erkent dat frontier-trainingen en grote infrastructuren sterk verbonden blijven met Nvidia’s GPU-platformen. Wat wel verandert, is de interne gewichtsverdeling binnen elk hyperscale datacentrum: terwijl training nog grotendeels onder GPU-dominantie blijft, verschuift inferentie naar gespecialiseerde accelerators waar operationele kosten beter kunnen worden afgestemd.

Een bijkomend punt is de snelheid bij Meta: het bedrijf beweert een capaciteit te hebben opgebouwd om ongeveer elke zes maanden een nieuwe chipgeneratie te lanceren, ondersteund door een modulaire chiplet-architectuur en hergebruik van dezelfde behuizing, rack en netwerk infrastructuur tussen generaties. Deze fysieke compatibiliteit maakt het mogelijk om nieuwe chips te integreren zonder volledige herontwerp van de implementatie, een cruciaal voordeel voor het verkorten van ontwikkelcycli, die anders één of twee jaar kunnen duren.

Daarnaast zet Meta sterk in op open source software en frictionless adoptie. Ze positioneren PyTorch, vLLM, Triton en het OCP-ecosysteem als de kern van MTIA. Dit is relevant omdat de strijd om silicium niet alleen in de chip zelf wordt uitgevochten, maar ook in de mate van interoperabiliteit en portabiliteit van modellen, kernels en inferentiestromen tussen platformen. Hoe meer het softwarestack gestandaardiseerd wordt, des te makkelijker het wordt voor hyperscalers om onderdelen van hun werk los te koppelen van het CUDA-ecosysteem.

Broadcom krijgt een steeds grotere rol achter de schermen

In deze race speelt Broadcom een steeds prominentere maar vaak onderbelichte rol. Meta noemt Broadcom als belangrijke partner bij de ontwikkeling van MTIA, en in oktober 2025 kondigde OpenAI een samenwerking aan met Broadcom voor de uitrol van 10 GW aan op maat gemaakte AI-accelerators. Hoewel elke samenwerking haar eigen particulariteiten heeft, illustreren deze allianties dat het ontwerpen van specifiek silicium een strategische prioriteit en investering is voor grootbedrijven met ruime kapitaalreserves en grote operationele schaal.

De conclusie is dus niet dat Nvidia haar dominantie heeft verloren; de industrie werkt er juist actief aan om minder afhankelijk te worden. Meta’s nieuwe MTIA-familie past in een logisch patroon: trainen waar het zinvol is met GPU’s, maar voor massale inferentie eigen silicium inzetten wanneer dit economisch rendabel is. Als inferentie de grote motor wordt achter AI-consumptie in de komende jaren, kan die keuze veel belangrijker uitpakken dan vandaag lijkt.

Veelgestelde vragen

Wat heeft Meta precies aangekondigd met MTIA?

Meta presenteert vier generaties eigen accelerators — MTIA 300, 400, 450 en 500 — met implementaties in productie of planning tussen 2026 en 2027, gericht op steeds meer inferentietaken binnen AI.

Waarom legt Meta zo’n nadruk op het HBM-bandbreedte?

Omdat, volgens het bedrijf, de HBM-bandbreedte een van de belangrijkste factoren is voor prestaties bij generatieve inferentie, vooral in de decodeerfase. Daarom neemt deze sterk toe bij MTIA 400, 450 en 500.

Betekent dit dat Nvidia zijn centrale rol verliest?

Nee. Het beleid richt zich vooral op het segmenteren van workloads: eigen chips voor grootschalige inferentie en GPU’s die nog altijd domineren in training en universele toepassingen.

Welke andere grote hyperscalers volgen deze strategie?

Google met Ironwood TPU, AWS met Trainium3 en Inferentia, en Microsoft met Maia 200 zetten ook sterk in op eigen siliciumontwikkeling voor AI en inferentie.

via: ai.meta.com