Intel en SoftBank, via SAIMEMORY, hebben nieuwe details gepresenteerd over HB3DM, een 3D-geheugen gebaseerd op Z-Angle Memory (ZAM) dat zich wil positioneren als alternatief voor traditioneel HBM bij AI-belastingen en high-performance computing. Hoewel het geen commerciële geheugenoplossing is die morgen HBM4 kan vervangen in accelerators van NVIDIA, AMD of Intel, vormt het een interessante technische innovatie, vooral nu geheugenbandbreedte een van de grootste beperkende factoren in AI-infrastructuren.

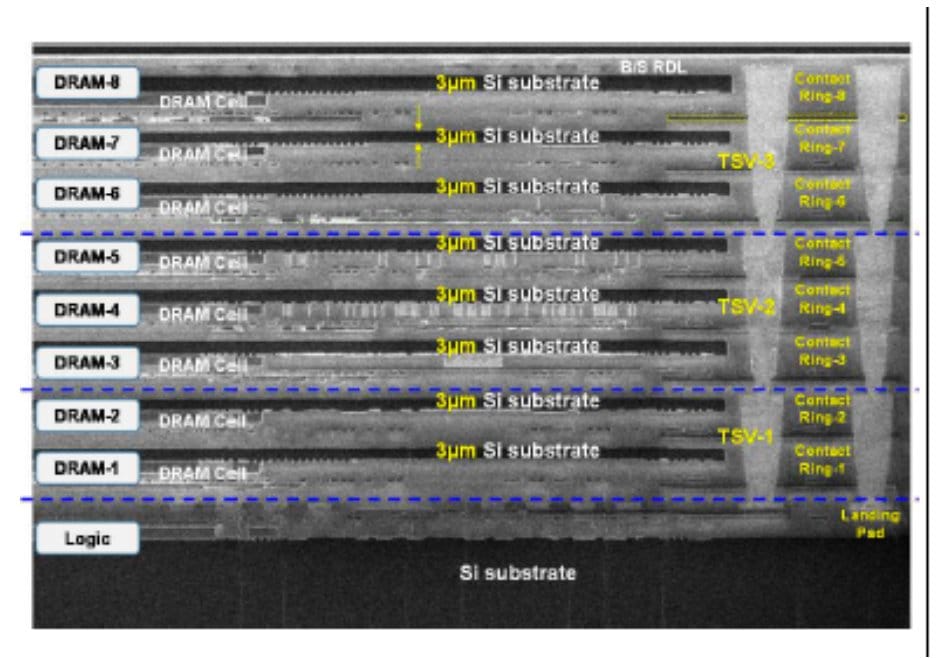

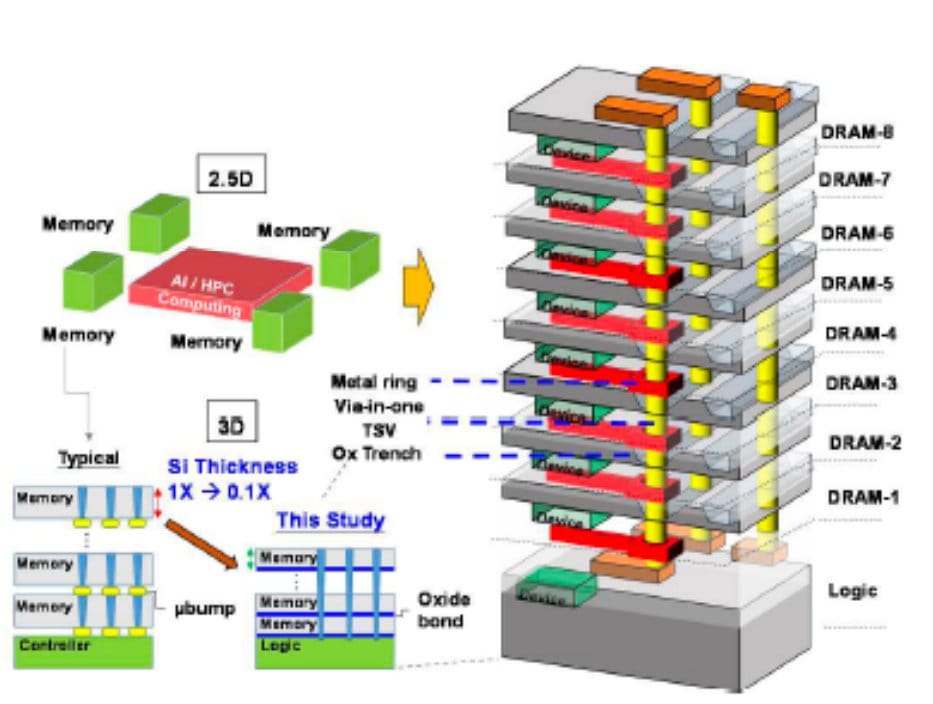

De informatie komt uit gegevens die tijdens een presentatie werden gedeeld voor het VLSI Symposium 2026, dat in juni in Honolulu plaatsvindt. Volgens de details wordt HB3DM voor het eerst gedemonstreerd met een configuratie van negen lagen: één logische laag aan de onderzijde en daarboven acht DRAM-lagen, verbonden via hybrid bonding en met een zeer dunne siliconen onderlaag van slechts 3 µm per DRAM-laag.

Wat biedt HB3DM ten opzichte van HBM?

De huidige HBM-architectuur bestaat al uit gestapelde DRAM-chips die verticaal verbonden zijn door TSV’s. HB3DM probeert deze integratie nog dichter te maken. De onderliggende logische laag beheert dataverkeer, terwijl de DRAM-lagen data opslaan. De belofte is duidelijk: meer bandwidth per oppervlak, lager stroomverbruik en een architectuur die beter afgestemd is op AI-accelerators.

SoftBank kondigde in februari aan dat haar dochteronderneming SAIMEMORY een overeenkomst had getekend met Intel om de commercialisering van Z-Angle Memory te versnellen, een nieuwe generatie geheugentechnologie ontworpen voor hoge capaciteit, hoge bandwidth en laag energieverbruik. Het doel is om prototypes te ontwikkelen in het fiscale jaar 2027 en de markt te betreden in 2029.

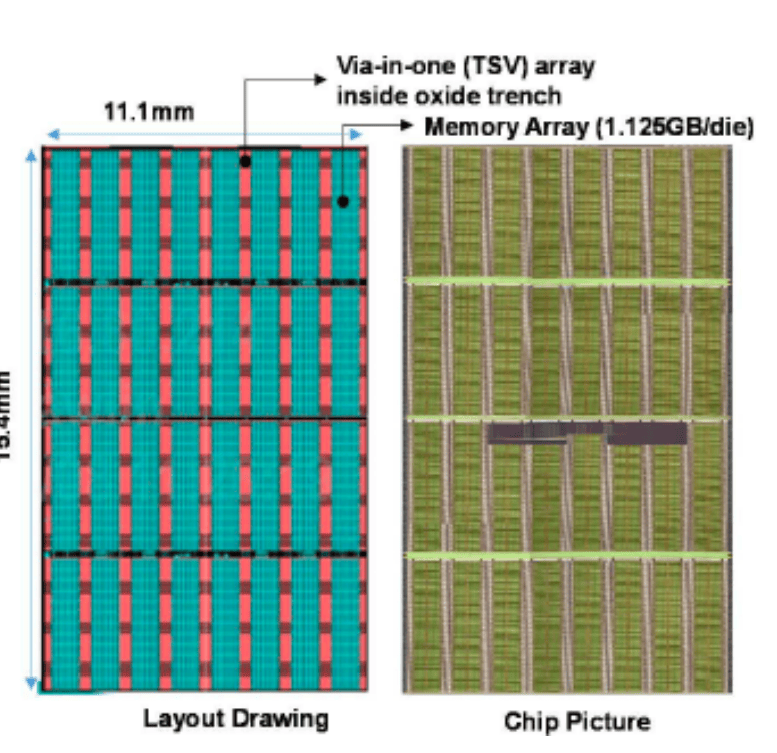

De technische details die van HB3DM bekend zijn, zijn indrukwekkend. Elke laag zou rond de 13.700 TSV’s bevatten, met een chipoppervlak van 171 mm², en het bandbreedteprofiel ligt op 0,25 Tb/s per mm². Over die oppervlakte berekent men ongeveer 5,3 TB/s per gestapelde stack. Qua capaciteit ligt de geschatte opslag bij circa 9-10 GB per module, aanzienlijk minder dan de 36 oder 48 GB die momenteel gangbaar zijn in HBM4.

| Kenmerk | HB3DM/ZAM, volgens gedeelde gegevens |

|---|---|

| Structuur | 1 logische laag + 8 DRAM-lagen |

| Totaallagen | 9 |

| Diaphragma- of waferdikte DRAM | 3 µm per laag |

| Verticale verbinding | Hybrid bonding |

| TSV’s per laag | Ongeveer 13.700 |

| Geschatte capaciteit | Rond 9-10 GB per stack |

| Die-area | 171 mm² |

| Bandbreedtedichtheid | 0,25 Tb/s/mm² |

| Geschat bandwidth | Ongeveer 5,3 TB/s per stack |

| Prototype-doelstelling | Fiscale jaar 2027 |

| Commerciële doelstelling | Fiscale jaar 2029 |

De vergelijking met HBM4 kent nuance. Micron noemt bijvoorbeeld HBM4 met een interface van 2.048 pennen, snelheden boven 11 Gbps en meer dan 2,8 TB/s per stack in de huidige generatie, inclusief 48 GB samples in 16-laags configuraties. HB3DM richt zich op meer bandwidth per stack, maar biedt aanzienlijk minder capaciteit. Beide variabelen zijn cruciaal voor AI-workloads: snelle datarotatie is nuttig, maar moet gepaard gaan met voldoende opslag dichtbij de processor.

Een veelbelovende architectuur, maar nog in een vroeg stadium

Dit is geen onmiddellijke vervanger van massaproductie-geheugen. Intel en SAIMEMORY richten zich eerst op prototypes en later op commerciële producten. HB3DM bevindt zich dus nog in de validatiefase en is geen directe vervanger voor de accelerators die in 2026 of 2027 op de markt komen.

Dit schema is relevant, omdat HBM zelf niet stilzit. SK hynix, Samsung en Micron werken aan HBM4 en HBM4E, met hogere capaciteit, grotere bandwidth en meer geavanceerde die-ontwerpen. Zodra ZAM klaar is voor massaproductie, kan de markt al kijken naar HBM5 of gespecialiseerde varianten voor grote klanten.

Desalniettemin is de concept veelbelovend. De behoefte aan high-bandwidth geheugen is enorm toegenomen door AI-ontwikkelingen. Modellen voor taal, multimodale systemen, agenten en inferentielasten vereisen grote gegevensvolumes met lage latentie en efficiënt energiegebruik. Schaarste en hoge kosten van HBM maken ruimte voor alternatieven, hoewel geen enkele optie gemakkelijk zal zijn.

De rol van Intel is daarbij interessant. Het bedrijf is jaren geleden gestopt met conventioneel geheugen, maar behoudt expertise in geavanceerde verpakking, interconnectie en stapeltechnologie. SoftBank wijst erop dat SAIMEMORY gebruikmaakt van technologieën en kennis uit de Next Generation DRAM Bonding-initiatieven van Intel, ontwikkeld binnen Amerikaanse programma’s voor geavanceerde geheugenontwikkeling.

Dat betekent niet dat Intel direct dramefabrieken gaat bouwen voor onderliggende geheugenlagen. Het is nog onduidelijk wie de DRAM-laag zal produceren en hoe de productieketen georganiseerd wordt. TrendForce waarschuwt dat het onduidelijk is wanneer SAIMEMORY haar chips zal commercialiseren en welk fabriceerder de basis-DRAM levert. De betrokkenheid van Intel suggereert echter een mogelijk indirecte terugkeer naar geavanceerd geheugen.

Meer bandwidth, minder capaciteit

De grote kracht van HB3DM ligt in het bandwidth-potentieel. Een stack die rond de 5,3 TB/s biedt, zou zeer concurrerend kunnen zijn voor workloads waar continue data toegang vereist is. Ook de oppervlaktestructuur kan helpen om versnellers compacter te maken of meer geheugenkanalen binnen hetzelfde pakketruimte te plaatsen.

De beperking is de capaciteit: zo’n 10 GB per module blijft ver achter bij de huidige en komende HBM4-standaarden. Voor grote AI-modellen moet de capaciteit en bandwidth samen groeien. Als een accelerator meerdere stacks nodig heeft om de capaciteit van HBM4 te evenaren, kunnen de voordelen in bandwidth verloren gaan door hogere complexiteit, kosten of energieverbruik.

HB3DM is daarom niet zomaar een vervanging voor HBM: het kan relevant worden in nichemarktsegmenten zoals inferentie, systemen die extreem veel bandwidth nodig hebben, HPC-toepassingen of zelfs geïntegreerd in eigen systemen van Intel als differentiatie ten opzichte van NVIDIA en AMD.

Ook de thermische efficiëntie wordt kritisch. Dens gestapelde geheugenstacks hebben een fysieke uitdaging: warmteafvoer tussen de lagen. ZAM belooft een lager energieverbruik en een design dat betere dissipatie mogelijk maakt, maar tot er meetgegevens beschikbaar zijn, blijft het onzeker hoe significant deze voordelen in werkende systemen zullen zijn.

De gerapporteerde energiebesparing tot 40% ten opzichte van traditioneel HBM, op basis van ZAM-gegevens, zou zeer relevant zijn in datacenters voor AI. Energie-efficiëntie is niet alleen kostentechnisch belangrijk voor operationele uitgaven, maar beïnvloedt ook koeling, rackdichtheid, stabiliteit en projectrobuustheid.

Een nieuwe strijdtoneel voor geheugentechnologie

HB3DM komt op een moment dat de industrie zich weer bewust wordt van een cruciaal inzicht dat systeemarchitecten jaren terug al benadrukten: de berekeningen worden nauwelijks benut als de geheugenbandbreedte niet toereikend is. AI heeft die beperking nu tot een strategisch probleem gemaakt.

Tot nu toe lag de focus vooral op GPU’s, accelerators en fabricagevolumes. Maar de bottleneck door geheugen wordt steeds zichtbaarder. HBM is kostbaar, moeilijk te fabriceren, beperkt in supply en vereist complexe verpakkingen. Alternatieven die meer bandwidth, lager energieverbruik of betere schaalbaarheid kunnen bieden, krijgen daardoor meer aandacht.

De vraag is of ZAM zich kan ontwikkelen van een technisch proefconcept tot een commercieel haalbare, rendabele en breed toepasbare oplossing. De hardware-industrie kent talloze veelbelovende ideeën die het niet haalden tot massaproductie. In geheugen is dat extra moeilijk, omdat het om performance, betrouwbaarheid, capaciteit, kosten, volumefabricage en langdurige validatie gaat.

Intel en SoftBank brengen een idee naar voren dat de aandacht verdient, maar nog bewijs moet leveren. HB3DM kan niet zomaar HBM4 vervangen op basis van bandwidth alleen. Het moet aantonen dat het schaalbaar is, dat de capaciteit kan groeien, dat productie haalbaar is, en dat grote systeemontwikkelaars het als een waardevol component zien, niet slechts een technische curiositeit.

De grote innovatie ligt erin dat niet alleen de snelheid van bestaande HBM wordt vergroot, maar dat nieuwe benaderingen zoals 3D-pakketten, chiplets en geavanceerde interconnectie de markt veranderen. HB3DM is zo’n alternatief. Gelooft men erin, dan kan Intel opnieuw een relevante speler worden op het gebied van geavanceerd geheugen. Zo niet, dan bevestigt het vooral de richting waarin de sector zich beweegt: de strijd in AI wordt ook gevoerd op microniveau tussen lagen van geheugen en processor.

Veelgestelde vragen

Wat is HB3DM?

HB3DM is een 3D-geheugenconcept gebaseerd op Z-Angle Memory en ontwikkeld via de samenwerking tussen Intel en SAIMEMORY, een dochteronderneming van SoftBank. Het richt zich op hoge bandwidth en laag energieverbruik voor AI en HPC.

Hoe verschilt het van HBM?

HB3DM gebruikt ook verticale stapeling, maar specialiseert zich in een zeer dunne, fijne 3D-integratie met DRAM-lagen van 3 µm, hybrid bonding en een onderlaag voor datamanagement.

Is het al een commerciële vervanger van HBM4?

Nee. Het bevindt zich nog in de demonstratiefase. SoftBank spreekt over prototypes in 2027 en marktintroductie in 2029.

Wat zijn de belangrijkste voordelen en beperkingen?

De belangrijkste plus is de hoge geschatte bandwidth van circa 5,3 TB/s per stack. Een belangrijk nadeel is dat de capaciteit met ongeveer 9-10 GB per stack nog ver achterblijft bij HBM4, dat vandaag al 36 of 48 GB biedt.

Nieuws van @Intel en @SoftBank SAIMEMORY van @VLSI_2026

Paper T17.5Eerste demo HB3DM

➡️ 9 lagen, 3 micron per stack

➡️ 1 logische + 8 DRAM-lagen

➡️ 13.7k TSV’s/laag met hybrid bonding

➡️ 1,125 GB/laag, dus 10 GB per stack

➡️ Bandbreedte 0,25 Tb/sec/mm2

➡️ Die van 171 mm2, dus 10… pic.twitter.com/q79qV4sRdT— Dr. Ian Cutress (@IanCutress) 29 april 2026