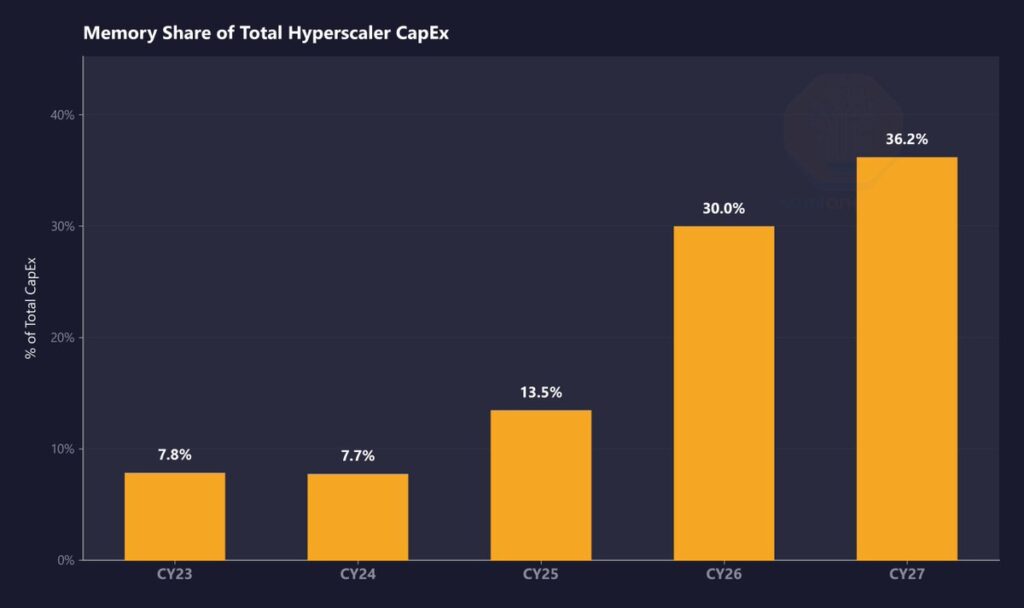

De komende grote uitdaging voor kunstmatige intelligentie lijkt niet alleen in GPU’s te liggen. Steeds meer analisten en fabrikanten richten zich op het geheugen, zodat er gesproken wordt van een nieuwe fase in de cyclus: een AI-infrastructuur waarin DRAM, LPDDR5 en HBM een steeds grotere rol spelen in de totale kosten van systemen en de capex van grote cloudoperatoren. SemiAnalysis heeft de meest agressieve voorspelling gedaan, waarin wordt geschat dat het geheugen zal stijgen van ongeveer 8% van de totale uitgaven van hyperscalers in 2023 en 2024 naar bijna 30% in 2026, met nog meer druk in 2027. Dit is een inschatting van dat bedrijf, geen officiële gids van de hyperscalers, maar het geeft goed de schaalverandering in de markt weer.

Deze verandering wordt niet ondersteund door één enkele variabele. Enerzijds blijft de capex voor datacenters toenemen onder invloed van AI. BloombergNEF verwacht dat de investeringen van grote operators rond de 750 miljard dollar in 2026 zullen liggen, terwijl Dell’Oro voorspelt dat de totale sectorcapex in 2030 kan oplopen tot 1,7 biljoen dollar. Anderzijds wordt een steeds groter deel van die uitgaven niet alleen door logisch silicium bepaald, maar ook door het geheugen dat vereist is voor acceleratoren, servers en volledige racks om steeds krachtigere trainings- en inferentiebelasting te ondersteunen.

De meest duidelijke indicator van deze druk komt uit de geheugenmarkt zelf. TrendForce voorspelt dat de contractprijzen voor conventioneel DRAM tussen 58% en 63% kunnen stijgen in het tweede kwartaal van 2026, na een al zeer gespannen eerste kwartaal, en wijt die stijging aan de herverdeling van capaciteit naar AI-gerelateerde toepassingen en servers, gecombineerd met een nog steeds krap aanbod. Het bedrijf verwacht dat het tekort zal blijven bestaan in 2026 en waarschijnlijk verder, omdat nieuwe productiefaciliteiten niet in volle volumes beschikbaar zullen zijn tot eind 2027 of 2028.

HBM, de meest zichtbare bottleneck

Waar deze geheugeninflatie het duidelijkst zichtbaar is, is in HBM. Micron bevestigde in de resultaten van het eerste fiscale kwartaal van 2026 dat ze prijs en volume voor alle HBM-uitvoer in de kalender van 2026 al vastgelegd hadden, inclusief HBM4. Het bedrijf verklaarde dat de capex-verhoging tot ongeveer 20 miljard dollar vooral bestemd was voor versterking van HBM-capaciteit en geavanceerde DRAM-nodes, maar erkende ook dat niet aan de volledige vraag van klanten kon worden voldaan.

SK hynix handelt in dezelfde richting. In hun officiële prognose voor 2026 beschrijven zij het huidige moment als een “AI memory supercyclus”, aangedreven door HBM3E en, in de volgende fase, door HBM4. Ze geven geen exacte cijfers over het gewicht in capex zoals SemiAnalysis, maar bevestigen wel dat geheugen niet langer slechts een onderdeel van de BOM is, maar een kerncomponent van het bedrijfsmodel.

Dit heeft directe gevolgen voor de kosten van AI-servers. Naarmate HBM een grotere component wordt binnen het systeem, wordt het geheel ook gevoeliger voor prijsstijgingen en aanbodbeperkingen. SemiAnalysis stelt dat deze druk al begint door te sijpelen in de capex-voorspellingen voor 2026, en dat de herprijzing voor 2027 nog niet volledig in de marktverwachtingen is verwerkt. Dit is weer een inschatting van dat bedrijf, geen officiële consensus, maar wordt ondersteund door het feit dat fabrikanten als Micron reeds een groot deel van hun HBM-capaciteit vooraf hebben verkocht.

DRAM en LPDDR5: minder opvallend, maar even kritisch

De publieke discussie richt zich vooral op HBM omdat dit het geheugen is dat het meest direct geassocieerd wordt met high-end AI-accelerators. Maar de druk geldt ook voor generieke DRAM en varianten zoals LPDDR5. TrendForce legt uit dat fabrikanten nog steeds prioriteit geven aan producten met hogere marges voor servers en bedrijven, wat de markt voor conventioneel geheugen verder onder druk zet. Dit verklaart waarom sommige analisten spreken over geheugen dat een groter deel van het cloudbudget ‘opvreet’, niet alleen bij de allersnelste systemen, maar ook bij de algemene infrastructuur die de uitbreiding van AI ondersteunt.

De prognose van SemiAnalysis over LPDDR5 — met contractprijzen die sinds het eerste kwartaal van 2025 meer dan verdrievoudigd zijn en openmarkt-prijzen boven de 10 dollar per GB in 2026 — moet gelezen worden als een inschatting van dit onderzoeksbureau, niet als een officieel bevestigd cijfer van fabrikanten. Toch sluit het goed aan bij bredere trends: hogere prestaties en lager energieverbruik maken dat deze geheugenversie steeds belangrijker wordt in architecturen waar efficiëntie en dichtheid cruciaal zijn.

Nvidia verzacht de impact; de rest van de markt niet

Een van de meest interessante nuances in het verhaal van SemiAnalysis is dat niet alle kopers even kwetsbaar zijn. Het bedrijf beweert dat NVIDIA profiteert van voorkeursleveringsvoorwaarden voor DRAM die beter tegen de inflatie kunnen, waardoor ze de totale kosten van hun servers beter kunnen beheersen. Andere spelers zouden meer blootstaan aan de prijsdruk. Deze bewering is niet publiekelijk bevestigd via contracten of officiële verklaringen van NVIDIA of haar leveranciers, dus moet het gezien worden als een marktinterpretatie. Maar het geeft wel een plausibele kijk op de realiteit: in een wereld van beperkte toevoer speelt het onderhandelingspositie en prioriteit een grote rol, net als de technische vraag die men stelt.

Dit kan ook verklaren waarom de inflatie en druk op de geheugenmarkt niet overal even hard wordt gevoeld. Een grote leverancier met schaal, meerjarige contracten en prioriteit bij de levering kan beter een inflatoire cyclus opvangen dan een kleinere speler met minder volume of onderhandelingsmacht. Zo kunnen de prijzen en beschikbaarheid van geheugen niet alleen de kosten van servers verhogen, maar ook competitieve voordelen binnen de markt voor accelerators en AI-systemen verschuiven. Dit is een plausibele inferentie op basis van marktgedrag en het vooraf verkopen van HBM-capaciteit, ook al wordt het niet expliciet universeel erkend.

De kernboodschap van de cyclus

De onderliggende conclusie is duidelijk: geheugen verplaatst zich van een secundaire uitgavepost in de BOM naar een centrale schakel in de kosten- en capaciteitsplanning van de infrastructuur. AI vereist niet alleen meer rekenkracht, maar ook meer bandbreedte, hogere dichtheid en snellere communicatie tussen processor en geheugen. Wanneer deze vraag geconfronteerd wordt met een rigide aanbod, geavanceerde nodes die moeilijk op te schalen zijn en HBM dat vooraf verkocht is, ontstaat er een markt die de capex, marges en inkoopstrategieën onder druk zet.

Als deze trend zich voortzet, kunnen 2026 en 2027 niet alleen herinnerd worden als de jaren van grootschalige AI-datacenter-uitbreidingen, maar ook als de jaren waarin geheugen van een aanvullende component evolueert naar een drijvende kracht die het spel in de infrastructuur mede bepaalt.

Veelgestelde vragen

Waarom wordt in de AI-infrastructuur zoveel over HBM gesproken?

Omdat HBM een veel hogere bandbreedte biedt dan conventionele DRAM en essentieel is voor het voeden van high-performance AI-accelerators. Micron heeft al bevestigd dat al haar HBM-aanbod voor 2026 vastligt, wat aangeeft dat de vraag zeer gespannen is.

Stijgt DRAM echt zo veel in 2026?

TrendForce voorspelt dat de contractprijzen voor conventioneel DRAM tussen 58% en 63% kunnen stijgen in het tweede kwartaal van 2026, na een al zeer stijgende eerste kwartaal. Dit betekent niet dat de prijzen in het hele jaar verdubbelen, maar bevestigt wel dat er een stevige druk op de markt staat.

Wordt officieel erkend dat geheugen 30% van de capex van hyperscalers zal uitmaken?

Nee, dat is geen officiële cijfers van de hyperscalers. Het is een inschatting door SemiAnalysis, die dit publiekelijk heeft gedeeld als onderdeel van hun analyse over de geheugen- en AI-cyclus.

Heeft de geheugencrisis alleen invloed op HBM?

Nee. HBM is het meest zichtbare geval, maar TrendForce ziet ook een gespannen markt voor conventioneel DRAM en NAND, door de herverdeling van capaciteit naar高-marginalegerelateerde toepassingen en servers.