Al tientallen jaren blinkt de robotica uit in toepassingen waar alles tot in de puntjes gemeten wordt: assemblagelijnen, gecontroleerde omgevingen, repeterende taken en vaste scripts. Maar de industrie is al enige tijd op zoek naar een kwalitatieve sprong: machines die zich kunnen bewegen in alledaagse scenario’s, met elke dag verschillende objecten, menselijke tussenkomst en ruimte voor fouten. In dit kader presenteert Microsoft Research Rho-alpha (ρα), hun eerste robotica-model gebaseerd op de familie Phi van visuele- en taalmethoden. Het doel is om de zogenoemde fysieke AI —de convergentie tussen intelligente systemen en fysieke apparaten— dichter bij robots te brengen die kunnen waarnemen, redeneren en handelen met meer autonomie.

Het bedrijf positioneert de aankondiging in de context van de opkomst van VLA (vision-language-action)-modellen voor fysieke systemen, een stroming die streeft naar integratie van perceptie (zien), begrip (taal) en uitvoering (handeling) in één operationeel ‘brein’. Ashley Llorens, vicevoorzitter en algemeen directeur van Microsoft Research Accelerator, stelt dat dit soort modellen systemen in staat stelt om meer autonomie te krijgen in minder gestructureerde omgevingen die veel meer op de echte wereld lijken dan fabrieken.

Van instructies begrijpen tot een robot laten bewegen

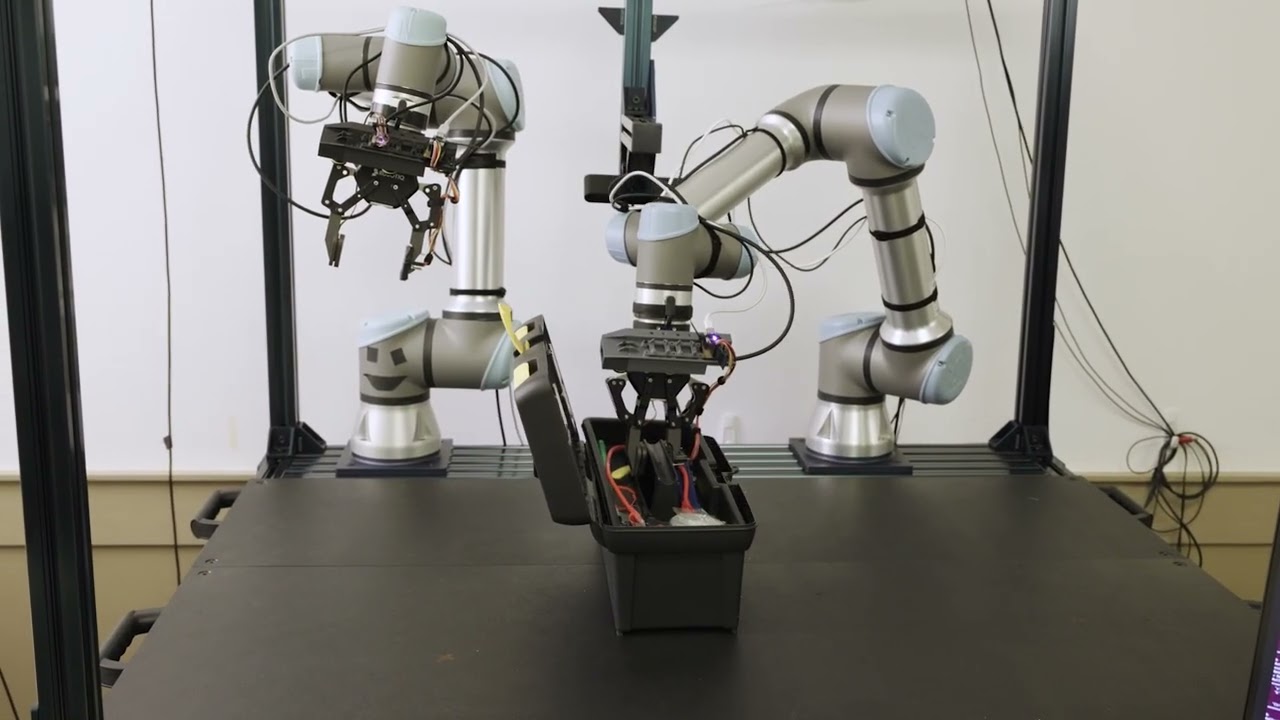

Rho-alpha is ontworpen om natuurlijke taalcommando’s te vertalen naar controle-signalen voor robots die bimanipulatie uitvoeren, dat wil zeggen taken die een fijne coördinatie van beide handen of grijpers vereisen: een knop indrukken, een draaiknop draaien, een schuif verplaatsen of een kabel trekken. Microsoft omschrijft het als een VLA+, omdat het de mogelijkheden uitbreidt ten opzichte van standaard VLA’s op twee belangrijke gebieden:

- Uitgebreide perceptie: het systeem integreert Tactiele sensoren en werkt momenteel aan het toevoegen van modaliteiten zoals kracht.

- Leervermogen tijdens gebruik: het model moet in de loop van de tijd verbeteren tijdens de operatie door te leren van menselijke feedback. Dit is vooral relevant wanneer de robot fouten maakt of vastloopt in een beweging.

Deze aanpak heeft één helder doel dat Microsoft continu benadrukt: aanpasbaarheid. In robotica betekent aanpassen niet zomaar een slogan; het maakt het verschil tussen een systeem dat enkel in demonstraties werkt en een dat operationeel stabiel blijft. Microsoft benadrukt dat robots die gedrag kunnen afstemmen op dynamische situaties en menselijke voorkeuren, waarschijnlijk nuttiger en vooral betrouwbaarder zullen zijn voor de gebruikers.

BusyBox, het testveld voor fysieke interactie

Om de aanpak te illustreren, wordt gebruikgemaakt van BusyBox, een recent geïntroduerde fysieke benchmark van Microsoft Research. In de getoonde video’s en voorbeelden reageert de robot op instructies zoals ‘druk op de groene knop’, ‘haal de rode kabel’, ‘draai aan de knop’ of ‘verplaats de schuif’, en voert de actie uit op een apparaat dat ontworpen is om manipulatievaardigheden te testen onder realistische omstandigheden.

BusyBox is vooral relevant vanwege één eenvoudige reden: jarenlang was het vergelijken van robotische vorderingen moeilijk door het ontbreken van gestandaardiseerde tests die de variëteit van de fysieke wereld weerspiegelen. Een interactiebank met verschillende objecten, mechanische weerstand, tolerantiemarges en mogelijke fouten helpt bij het meten van iets dat voor robotica net zo belangrijk is als precisie: het vermogen tot recuperatie als dingen niet meteen lukken.

De grootste uitdaging: data (en data met tactiele feedback)

Een fundamenteel probleem in moderne robotica is de tekort aan grote datasets voor training, vergelijkbaar met die voor taal- of beeldmodellen. Het vastleggen van fysieke demonstraties is duur, tijdrovend en soms praktisch onmogelijk. Microsoft benadrukt daarom dat simulatie cruciaal is voor het overbruggen van dit gat in de pre-training data, vooral bij het integreren van zeldzame signalen zoals tactiele informatie.

De aanpak van het team combineert:

- Fysieke demonstratieroutes (echte data).

- Gesimuleerde taken, gegenereerd via een gelaagd pipeline ondersteund door versterkingsleren.

- De integratie van simulaties met het framework NVIDIA Isaac Sim en gebruik van Azure voor het creëren van synthetische, fysiek plausibele datasets.

- Extra co-training met webdata voor ‘visual question answering’ (visuele vraag-en-antwoord), om visie-taalbegrip in gedrag te integreren.

De boodschap is duidelijk: robotica heeft modellen nodig die niet alleen zien, maar ook voelen en real-time kunnen aanpassen. Daar wordt tactiele feedback onderdeel van, wat kunnen betekenen dat fouten bij het vastpakken, aansluiten, sluiten, schroeven of onderdelen met toleranties, verminderd worden.

Menselijke feedback in de lus: corrigeren om te leren

Microsoft erkent een ander knelpunt: zelfs met verbeterde perceptie kunnen robots fouten maken die moeilijk drop te lossen zijn zonder menselijke tussenkomst. Daarom werkt het team aan tools en technieken zodat het systeem kan leren van menselijke correcties tijdens het gebruik, bijvoorbeeld via intuïtieve teleoperatietechnologieën zoals een 3D-muis. Een voorbeeld laat zien hoe een robot bij het aansluiten van een stekker moeite heeft en hulp krijgt van een menselijke operator in realtime.

Deze ‘human-in-the-loop’-aanpak is geen detail: in echte situaties bepaalt de overgang tussen autonome werking en assistentie voor een groot deel of een robot de werkbelasting verlaagt of verhoogt met incidenten.

Wat komt hierna: evaluatie, vroege toegang en uitbreiding naar platformniveau

Microsoft meldt dat Rho-alpha onder evaluatie is in configuraties met dubbel-armen en humanoïde robots. Ze zullen binnen enkele maanden een technische beschrijving publiceren. Daarnaast nodigt het uit tot deelname aan een Research Early Access Program en verwacht dat het model later zal worden uitgerold binnen Microsoft Foundry.

Voor de industrie is de boodschap duidelijk: de race om kunstmatige intelligentie beperkt zich niet meer tot tekst- of beeldgeneratie. Het verschuift naar systemen die wikken en wegen in de fysieke wereld, met een complexe mix van multimodale perceptie, fijne controle en continu leren. En in dat speelveld wordt tastzin —samen met simulaties en menselijke feedback— een sleutelfactor om van spectaculaire demos naar nuttige robotica te gaan.

Veelgestelde vragen

Wat is een VLA-model en waarom is dat belangrijk voor robotica?

Een vision-language-action (VLA)-model probeert wat een robot ziet, wat het begrijpt in taal en wat het doet (controle-acties) te verbinden. Zo kan een robot functioneren in minder gestructureerde omgevingen dan de standaard industriële settings.

Wat brengt tactiele feedback aan een robot ten opzichte van alleen vision?

De tastzin helpt bij het detecteren van contact, weerstand en glijdingen. Vooral bij delicate manipulatie-taken zoals stekkers, schakelaars, kabels of kleppen, waar visuele informatie niet altijd voldoende is door obstructies of fysieke variaties.

Wat is BusyBox en waarvoor wordt het gebruikt?

BusyBox is een door Microsoft Research ontwikkelde fysieke benchmark om vaardigheden in interactie en manipulatie te beoordelen via taken met natuurlijke taal, zoals schuifregelaars bedienen, schakelaars activeren of draaiknoppen draaien.

Wanneer zal Rho-alpha buiten het lab gebruikt kunnen worden?

Microsoft heeft een early access-programma aangekondigd voor organisaties en plant om later meer technische details vrij te geven via Microsoft Foundry. Een volledige publicatie wordt in de loop verwacht.

vía: microsoft